Neuralink passe à l’expérimentation humaine

Dans les projets un peu fous et qui font peur d’Elon Musk, il y a Neuralink. Cette startup veut implanter une puce dans notre cerveau pour y faire on ne sait pas trop quoi. Et un premier humain est désormais implanté.

Crédit image : InformatiqueNews

Crédit image : InformatiqueNews

Créée en 2016 par le milliardaire fantasque Elon Musk, Neuralink s’est spécialisée dans les interfaces neuronales, autrement dit des composants électroniques qui viennent s’interfacer directement au cerveau dans l’espoir d’en capter la pensée, d’augmenter le potentiel de mémorisation, d’étendre l’intelligence humaine à l’IA et concrétiser plein d’autres fantasmes de la science-fiction.

Testé sur des animaux et notamment des singes depuis quelques années, l’implant Neuralink N1 est une puce qui s’attache sur le squelette et est relié à 1024 électrodes placées directement sur et dans le cerveau afin de détecter mais aussi stimuler des millions de neurones simultanément.

En mai dernier, l’entreprise avait obtenu de la FDA (Food & Drug Administration) américaine l’autorisation de procéder aux expérimentations humaines. Neuralink avait alors lancé un appel aux volontaires.

Elon Musk a confirmé cette semaine sur X qu’un premier patient venait d’être implanté et se remettait de cette première opération. Ajoutant « les premiers résultats montrent de prometteuses détection de pics neuronaux ».

Neuralink a de grandes espérances sur cette technologie pour interfacer le cerveau aux ordinateurs. Elle estime qu’à terme cette technologie pourrait d’une manière générale améliorer les capacités humaines et aider des patients souffrant de certains handicaps comme les paralysies.

Elon Musk en est même convaincu, de telles interfaces seront indispensables à l’humanité si elle veut survivre aux futures AGI (les intelligences artificielles générales).

D’ici là, si jamais le système fonctionne un jour, Neuralink espère vous permettre de piloter votre téléphone ou votre ordinateur par la pensée. L’entreprise vise en priorité des personnes ayant perdu l’usage de leurs membres.

Source :

Informatique News

Publié le par Informatique News

En parler sur le forum

Vers une ère de responsabilité numérique : le débat sur l'identité et l'anonymat en ligne en France

La quête d'équilibre entre la protection des citoyens et la préservation des libertés individuelles dans l'univers digital français

Paul Midy. (Crédits : © LTD / AN)

Paul Midy. (Crédits : © LTD / AN)

Dans le sillage des débats incessants sur la nécessité de sécuriser et réguler l'espace numérique (SREN) tout en préservant les libertés individuelles, le projet de loi sur le numérique en France a connu un parcours législatif marqué par des positions nuancées et des revirements stratégiques. Portée initialement en 2023 par Paul Midy, figure de la majorité Renaissance, cette législation visait à réguler l'espace numérique en luttant contre la cybercriminalité, tout en proposant une avancée significative : la généralisation de l'identité numérique d'ici 2027. Cette ambition se concrétisait par le déploiement à grande échelle de l'identité numérique pour sécuriser les démarches administratives, dans le prolongement de la digitalisation des services de l'État déjà amorcée.

Toutefois, l'aspect le plus controversé du projet — la suppression de l'anonymat en ligne — a été rapidement abandonné. Face à l'opposition de divers groupes politiques, Paul Midy a retiré les amendements concernant la levée de l'anonymat, optant plutôt pour un compromis : le pseudonymat. Cette décision reflète un souci de préserver une certaine liberté d'expression en ligne, tout en s'attaquant aux problématiques de cyberharcèlement et de discours haineux qui sévissent sur Internet.

Un an plus tard, en 2024, l'initiative a été relancée par un collectif de 125 députés de la majorité, toujours sous l'égide de Paul Midy. Cette nouvelle proposition met l'accent sur la création d'une identité numérique vérifiée, visant à responsabiliser les utilisateurs des réseaux sociaux. Selon Paul Midy, cette mesure vise à réduire le sentiment d'impunité engendré par l'anonymat en ligne, qui contribue à l'escalade de la violence numérique. En mettant en place un système où chaque compte serait lié à une identité numérique, accessible par les autorités en cas de comportement délictueux, le projet espère endiguer les fléaux du cyberharcèlement et de la désinformation, tout en protégeant les activités légitimes telles que le journalisme d'investigation et le lancement d'alerte.

Le débat autour de l'identité numérique et de la fin de l'anonymat en ligne soulève des questions fondamentales sur l'équilibre entre sécurité et liberté dans l'espace numérique. Alors que les mesures proposées visent à protéger les citoyens, notamment les plus jeunes, contre les dangers du cyberespace, elles suscitent également des inquiétudes quant au risque de surveillance et de restriction des libertés individuelles. La tension entre ces objectifs divergents continuera probablement à animer le débat public, alors que les décideurs cherchent des solutions pour adapter le cadre législatif aux défis posés par la digitalisation croissante de la société.

Sources multiples :

LCP

La Tribune

BFM Tech&Co

Publié le par Technifree

En parler sur le forum

Grok-1, le Grand Modèle de Langage d'Elon Musk, Défie les Géants de l'IA

Dans un monde où la course à l'intelligence artificielle bat son plein, une nouvelle étape a été franchie avec l'arrivée de Grok-1, le dernier-né de la start-up xAI, fondée par Elon Musk. Ce grand modèle de langage (LLM) open source marque un tournant dans l'industrie par ses performances et son accessibilité, défiant directement des acteurs établis comme OpenAI.

Crédit image : web

Crédit image : web

Une Puissance de Calcul Inégalée

Grok-1 se distingue par une capacité impressionnante de 314 milliards de paramètres, le positionnant loin devant ses concurrents immédiats. Ce modèle "transformer", basé sur la technique Mixture-of-Experts (MoE), promet une efficacité et une flexibilité sans précédent. Grâce à sa licence Apache 2.0, les développeurs du monde entier peuvent désormais l'utiliser, le modifier et le distribuer librement, ouvrant la voie à une multitude d'applications personnalisées.

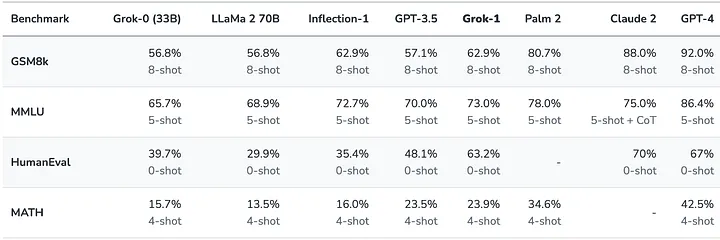

Des Performances Révolutionnaires

Sur le benchmark MMLU (Measuring massive multitask language understanding), Grok-1 a réalisé un score de 73%, surpassant ainsi des modèles renommés comme Llama 2 70B de Meta et GPT-3.5 d'OpenAI. En matière de complétion de code, le modèle établit également de nouveaux standards avec un score de 63.2% sur HumanEval, démontrant sa capacité à comprendre et à générer du code de manière plus efficace que jamais.

Crédit image : xAI

Crédit image : xAI

Grok-1 au Cœur de l'Innovation sur le Réseau Social X

Au-delà de ses prouesses techniques, Grok-1 alimente également le chatbot Grok, disponible sur le réseau social X. Cette intégration marque un pas significatif dans l'utilisation des LLM dans les interactions quotidiennes et souligne la volonté d'Elon Musk de faire progresser le domaine de l'IA générative.

Une Rivalité Croissante avec OpenAI

La publication de Grok-1 s'inscrit dans un contexte de tension croissante entre Elon Musk et OpenAI, notamment autour des questions de l'open source et des objectifs initiaux des entreprises dans le domaine de l'IA. En rendant Grok-1 accessible à tous, Musk défie directement la stratégie d'OpenAI, poussant plus loin le débat sur l'avenir et l'éthique de l'intelligence artificielle.

Un Avenir Ouvert et Collaboratif pour l'IA

Avec Grok-1, xAI et Elon Musk posent les bases d'une approche plus ouverte et collaborative de l'intelligence artificielle. Ce modèle open source pourrait bien changer la donne, permettant une innovation accélérée et une adoption plus large des technologies d'IA. L'impact de Grok-1 sur l'industrie, tant en termes de développement de logiciels que de réflexion éthique, sera sans doute un sujet à suivre de près dans les années à venir.

Sources multiples :

L'usine Digitale

xAI

Publié le par Technifree

En parler sur le forum

L'Europe se dote d'une législation avant-gardiste sur l'intelligence artificielle

Dans un monde de plus en plus tourné vers le numérique, l'intelligence artificielle (IA) façonne notre quotidien de manière inédite. Reconnaissant à la fois le potentiel immense et les risques potentiels associés à ces technologies, le Parlement européen a franchi une étape cruciale en adoptant une législation pionnière sur l'IA. Mercredi, les députés ont massivement voté en faveur de cette loi, avec 523 votes pour, 46 contre et 49 abstentions, marquant un moment historique dans la régulation de l'IA.

Crédit image : (C) AlexanderAdobeStock

Crédit image : (C) AlexanderAdobeStock

Équilibre entre innovation et protection

La nouvelle législation, issue de négociations avec les États membres conclues en décembre 2023, vise à établir un équilibre délicat : garantir la sécurité et le respect des droits fondamentaux tout en stimulant l'innovation technologique. Ce règlement européen établit des obligations spécifiques pour les systèmes d'IA, classées en fonction de leur niveau de risque et de leur impact potentiel. L'objectif ? Faire de l'Europe un acteur de premier plan dans le domaine de l'IA, tout en protégeant ses citoyens et ses valeurs fondamentales.

Interdictions et exemptions : les grandes lignes

Certains usages de l'IA seront dorénavant interdits au sein de l'UE, notamment ceux menaçant les droits individuels. Cela inclut les systèmes de reconnaissance biométrique sensible, l'extraction massive d'images faciales, la reconnaissance des émotions au travail ou dans les écoles, la notation sociale, la police prédictive basée uniquement sur le profilage, ainsi que toute IA manipulant le comportement humain. Néanmoins, des exemptions sont prévues pour les services répressifs dans des cas bien définis, encadrés par des garanties strictes.

Responsabilités accrues pour les systèmes à haut risque

Les systèmes d'IA considérés comme à haut risque devront répondre à des exigences rigoureuses. Ils seront soumis à une évaluation approfondie des risques, devront être transparents, précis, et inclure une supervision humaine. Cette catégorie couvre une vaste gamme d'applications, des infrastructures critiques à la gestion des frontières, en passant par l'éducation et la santé.

Vers une IA transparente et responsable

La législation met aussi l'accent sur la transparence, notamment pour les IA dites "à usage général". Elle exige la publication de résumés détaillés sur les données utilisées pour l'entraînement des modèles, et met en garde contre les contenus artificiels non signalés, tels que les deepfakes.

Soutien à l'innovation et aux PME

Pour ne pas brider l'innovation, la loi prévoit la création de "bacs à sable réglementaires" permettant aux entreprises, en particulier PME et start-ups, de tester des IA novatrices dans un cadre contrôlé.

Réactions et perspectives

Les co-rapporteurs du Parlement, Brando Benifei et Dragos Tudorache, ont salué cette adoption comme un pas vers une IA éthique et encadrée, mettant l'humain et les valeurs européennes au cœur du développement technologique. Toutefois, ils soulignent aussi le chemin restant à parcourir pour intégrer pleinement l'IA dans nos sociétés de manière responsable.

Et après ?

Le texte doit encore être officiellement adopté par le Conseil et passer une dernière vérification juridique. La législation entrera en vigueur 20 jours après sa publication au Journal officiel de l'Union européenne, avec une application progressive des différentes dispositions sur 6 à 36 mois. Ce cadre réglementaire place l'Europe à l'avant-garde de la gouvernance de l'IA, un modèle potentiellement inspirant pour le reste du monde.

Source :

Parlement Européen | Yasmina YAKIMOVA

Publié le par Technifree

En parler sur le forum

Fin de la carte verte d’assurance automobile : ce qu’il faut savoir

À partir du 1er avril 2024, une évolution majeure dans le monde de l'assurance automobile en France prendra effet. La traditionnelle carte verte, symbole de l’assurance obligatoire pour tout véhicule terrestre à moteur, ne sera plus nécessaire. Cet article vous guide à travers les changements annoncés et ce qu'ils signifient pour les conducteurs français.

Crédit image : W-Assur

Crédit image : W-Assur

Selon un décret publié au Journal officiel le 9 décembre 2023, la nécessité d'afficher le certificat d'assurance, communément appelé "papillon vert", sur le pare-brise des véhicules sera abolie. Cette décision s'inscrit dans une démarche de modernisation et de simplification administratives, permettant une vérification numérique de l'assurance via le fichier des véhicules assurés (FVA).

Le Fichier des Véhicules Assurés (FVA) au cœur du dispositif

Le FVA devient l'outil central pour les forces de l'ordre pour vérifier l'assurance d'un véhicule. Alimenté par les assureurs, ce fichier numérique répertorie les contrats d’assurance actifs, offrant une méthode de contrôle plus efficace et instantanée.

Quid des documents d’assurance ?

Bien que le "papillon vert" disparaisse, les automobilistes ne sont pas laissés sans documents. Les assureurs fourniront désormais un "mémo véhicule assuré" lors de la souscription ou du changement de véhicule, facilitant le contrôle en cas de besoin et offrant une aide précieuse pour la rédaction d'un constat amiable ou en cas de panne.

Exceptions (eh oui, y'en a !)

Les véhicules non immatriculés, tels que les engins de déplacement personnel motorisés (EDPM : trottinette électrique, tondeuse à gazon, La voiture à pile de Gaston Lagaffe ...), restent soumis à l'obligation de présenter une attestation d’assurance physique. Par ailleurs, les conducteurs peuvent dès à présent vérifier en ligne la présence de leur véhicule dans le FVA, garantissant ainsi leur conformité avec la loi.

Ce changement rappelle également l'importance fondamentale de l'assurance responsabilité civile, couvrant les dommages que le véhicule peut occasionner. Chaque propriétaire de véhicule doit veiller à sa souscription, garantissant ainsi la sécurité de tous.

L'abolition de la carte verte et du papillon vert marque une étape importante vers la digitalisation et la simplification des processus administratifs en France. Ce changement, prenant effet le 1er avril 2024, souligne l'évolution des pratiques en matière d'assurance automobile, facilitant la vie des conducteurs tout en assurant une gestion efficace et moderne des obligations d'assurance.

Sources :

Décret n°2023-1152 du 08/12/2023

service-public.fr

Publié le par Technifree

En parler sur le forum

L'Intelligence Artificielle : Une Révolution à Maîtriser pour la Prospérité de la France

L'intelligence artificielle (IA) est à la croisée des chemins en France, selon le dernier rapport de la Commission de l'Intelligence Artificielle daté de mars 2024. Ce document majeur propose une vision ambitieuse et des recommandations stratégiques pour que la France et l'Europe s'emparent pleinement des opportunités offertes par cette révolution technologique.

Crédit image : Elysee.fr

Crédit image : Elysee.fr

L'IA, avec l'avènement récent de l'IA générative, touche désormais tous les aspects de la vie économique et sociale. Bien que l'Europe possède un réservoir exceptionnel de talents, elle fait face à un retard technologique et économique significatif. Pour inverser cette tendance, la commission présente six axes d'intervention, de la formation à la gouvernance mondiale.

Pour déployer efficacement l'IA, le rapport insiste sur la nécessité de :

• Sensibiliser et former la population aux impacts de l'IA.

• Réorienter l'épargne vers l'innovation, avec la création d'un fonds "France & IA".

• Positionner la France comme un leader de la puissance de calcul, essentielle à l'IA.

• Assurer une gouvernance mondiale de l'IA pour un développement harmonieux et éthique.

Une approche exhaustive a été adoptée pour élaborer ce rapport, incluant 600 auditions d'experts et une consultation de 7 000 citoyens. Cette méthodologie collégiale et ouverte garantit des recommandations bien fondées et largement acceptées.

Le rapport de la Commission de l'Intelligence Artificielle marque un tournant dans la stratégie nationale sur l'IA, avec 25 recommandations clés réparties en six axes principaux. Ces recommandations visent à positionner la France comme un leader de l'IA, tout en assurant un développement équilibré et responsable de cette technologie.

• Sensibilisation et Formation: Lancer un programme national pour éduquer le grand public sur l'IA, incluant des débats publics et des formations continues.

• Financement de l'Innovation: Création d'un fonds "France & IA" doté de 10 milliards d'euros pour soutenir l'écosystème d'IA français.

• Puissance de Calcul: Établir la France comme un centre majeur de la puissance de calcul, crucial pour le développement de l'IA.

• Accès aux Données: Faciliter l'accès à des données de qualité, essentielles pour l'entraînement des modèles d'IA.

• Recherche et Développement: Doubler les investissements dans la recherche publique spécialisée en IA et favoriser les collaborations entre secteurs public et privé.

• Gouvernance Mondiale de l'IA: Promouvoir la création d'une Organisation Mondiale de l'IA pour une régulation et un encadrement éthique au niveau international.

Les recommandations détaillent également l'importance de:

• Développer des compétences en IA dès le plus jeune âge et tout au long de la vie.

• Soutenir les startups et les PME dans l'intégration de l'IA.

• Assurer une transition équitable pour les travailleurs impactés par l'IA.

• Renforcer la sécurité et la protection des données dans les applications d'IA.

• Encourager une approche humaniste de l'IA, garantissant que la technologie serve l'intérêt général.

Chacune de ces recommandations s'accompagne de propositions d'actions concrètes, reflétant l'ambition de la France de naviguer avec succès dans la révolution de l'IA, en faisant de cette technologie un moteur de croissance, d'innovation, et de bien-être social.

L'IA représente une formidable opportunité de progrès pour la France, à condition de la maîtriser et de la déployer au service de tous. La mise en œuvre des recommandations de la commission constitue un investissement stratégique pour l'avenir, permettant à la France de jouer un rôle de premier plan dans la révolution de l'IA. Ce chemin nécessite un engagement collectif, une vision à long terme, et une action publique résolue. L'heure est à la mobilisation pour assurer que l'IA génère croissance, emplois, et bien-être, dans le respect de nos valeurs et de notre souveraineté.

Mistral, LightOn, Shift Technology, Alan, Bioptimus, Google : ils sont de plus en plus nombreux à choisir la France pour innover en matière d’intelligence artificielle. Fierté.

En investissant, nous faisons de la France un pays à la pointe de l’IA.

Une IA le dit aussi ! pic.twitter.com/V79TwxGOU7

— Emmanuel Macron (@EmmanuelMacron) March 13, 2024

Sources multiples :

Elysee.fr

Le rapport (pdf)

Publié le par Technifree

En parler sur le forum

Cyberattaque sans précédent contre les services de l'État français : vers une refonte de la sécurité informatique en Europe

Depuis le dimanche 10 mars 2024, les services de l’État français sont la cible d'une cyberattaque d'une "intensité inédite", selon les déclarations de Matignon. Bien que la source de cette attaque reste encore indéterminée, le gouvernement français a immédiatement déployé des contre-mesures pour faire face à cette menace sans précédent.

Crédit image : DALL-E

Crédit image : DALL-E

Selon les informations recueillies par BFMTV, cette attaque informatique, dont l'origine demeure obscure, a ciblé de nombreux services ministériels, mettant ainsi en péril le bon fonctionnement de l'administration. Bien que des efforts aient été déployés pour réduire l'impact de cette cyberattaque, l'ampleur de la menace a nécessité l'activation d'une cellule de crise dès son déclenchement.

Cette attaque souligne une fois de plus l'importance cruciale de la cybersécurité dans le maintien de la stabilité des États face aux menaces extérieures. À cet égard, l'investissement dans des technologies de pointe telles que les ordinateurs quantiques devient indispensable pour garantir la sécurité des infrastructures nationales.

Dans un contexte où les cyberattaques représentent une menace croissante, l'Union européenne a récemment dévoilé un ambitieux projet de "bouclier cyber" d'une valeur d'un milliard d'euros. Ce projet vise à renforcer la capacité des États membres à réagir rapidement et efficacement aux attaques informatiques, en s'appuyant sur des cyber hubs équipés d'intelligence artificielle et de supercalculateurs.

Le "bouclier cyber" de l'UE s'inscrit dans une stratégie plus large visant à protéger les infrastructures critiques des États membres contre les cybermenaces. En plus de la création de cyber hubs, l'UE prévoit également la mise en place d'une "réserve cyber" composée de milliers de spécialistes volontaires, prêts à intervenir en cas d'urgence.

Ces initiatives témoignent de la volonté de l'Union européenne de renforcer sa défense contre les cyberattaques, qui représentent une menace croissante pour la sécurité et la stabilité du pays. Alors que les cyberattaques continuent de se multiplier, il est impératif pour les États membres de collaborer étroitement pour faire face à cette menace commune.

En France, où les cyberattaques ont déjà coûté près de 2 milliards d'euros en 2022, ces récents événements soulignent l'urgence d'adopter des mesures efficaces pour protéger les infrastructures nationales contre les cybermenaces. La sécurité informatique ne peut plus être considérée comme un domaine secondaire, mais plutôt comme une priorité absolue pour assurer la résilience des États face aux menaces du monde numérique.

Sources multiples :

BFMTV

Les Numériques

FranceInfo

Publié le par Technifree

En parler sur le forum

M. Lecornu annonce la création d’une Agence ministérielle de l’intelligence artificielle de Défense

Comme l’avait soutenu le stratégiste allemand Carl von Clausewitz, la « guerre est un caméléon qui change de nature à chaque engagement ». Qu’en sera-t-il avec la généralisation de l’intelligence artificielle [IA] sur le champ de bataille, sachant que les applications militaires de cette technologie sont déjà nombreuses ?

Crédit image : Opex360

Crédit image : Opex360

Récemment, le chef d’état-major de l’armée de Terre [CEMAT], le général Pierre Schill, a répondu à cette question en affirmant que la guerre restera ce qu’elle est, c’est à dire un « affrontement humain ». Mais « si s’approprier l’IA ne garantira pas nos succès à venir, omettre de le faire garantira d’emblée un déclassement dans les combats de demain », a-t-il estimé.

Quoi qu’il en soit, la Loi de programmation militaire [LPM] 2019-25 avait fait de l’IA une priorité. Ce qui s’était traduit par le lancement de plusieurs programmes, dont le très ambitieux Artemis IA [ARchitecture de Traitement et d’Exploitation Massive de l’Information multi-Sources], lequel vise à doter le ministère des Armées d’une solution « souveraine » en matière de stockage et d’exploitation de l’information, ou encore « TORNADE » [Traitement Optique et Radar par Neurones Artificiels via Détecteur], confié à l’entreprise Preligens.

Par ailleurs, la Direction générale de l’armement [DGA] finança les études MMT [Man-Machine-Teaming, pour l’aviation de chasse du futur] et HYPERION, afin de développer des algorithmes d’IA susceptibles de « contribuer aux performances futures du combat collaboratif terrestre ». Dans le même temps, un cadre éthique pour l’usage de cette technologie fut défini.

Entrée en vigueur le 1er août dernier, la LPM 2024-30 prévoit d’accentuer l’effort en matière d’intelligence artificielle.

L’objectif poursuivi à travers le développement de l’IA est de s’assurer que les armées puissent traiter de façon autonome le flux de données apporté par les capteurs dont elles disposent et qu’elles consolident ainsi leur capacité d’appréciation des situations stratégiques et tactiques

Et celui-ci d’ajouter :

Cette fonction d’analyse des données grâce à l’usage de l’IA permettra d’optimiser l’ensemble des investissements réalisés dans les capteurs et sera mise au service de l’ensemble des forces armées. Dans cette perspective, la création d’une ligne budgétaire dédiée aux logiciels d’IA pour la défense sera envisagée et les impacts de l’IA sur la fonction renseignement et sur la chaîne ‘commandement et contrôle’ [C2] seront évalués

Évidemment, au-delà de la robotique, d’autres applications peuvent être envisagées, notamment en matière de maintien en condition opérationnelle [MCO]. L’IA peut aussi permettre d’améliorer la précision des armes [ce qui sera le cas pour le CAESAr] et apporter une aide à la décision et à la planification des opérations.

Aussi, le ministère des Armées entend changer de braquet. Dans les pages du quotidien Les Échos, ce 8 mars, le ministre des Armées, Sébastien Lecornu, a annoncé la création, en juillet prochain, de l’Agence ministérielle de l’intelligence artificielle de défense [AMIAD], qui sera le pendant de la Direction des applications militaire [DAM] du Commissariat à l’énergie atomique et des énergies renouvelables [CEA]. C’est dire l’importance des attentes en la matière…

Soit l’armée française prend date, soit elle décroche

, a fait valoir M. Lecornu.

La mission de l’AMIAD consistera à « conceptualiser, voire fabriquer, l’intelligence artificielle dans les grands programmes militaires, actuels comme futurs », a précisé le ministre.

Pour cela, cette agence disposera d’un budget de 300 millions d’euros par an et de son propre supercalculateur « classifié » censé traiter « souverainement des données secret-défense ». Selon le ministre, « non seulement les armées pourront tester l’IA embarquée dans les systèmes d’armes en maintenant un fort degré de protection, mais les industries de défense pourront aussi l’utiliser et le nourrir avec leurs données, sans crainte d’espionnage ».

Devant être installé au Mont Valérien, ce supercalculateur, décrit par le ministre comme étant le « plus gros dédié à l’IA en Europe », devrait être mis en service en 2025. La procédure d’acquisition, pour laquelle 200 à 300 millions d’euros sont prévus, sera lancée très bientôt.

Enfin, l’AMIAD devra recruter 300 ingénieurs, chercheurs et doctorants, civils et militaires, dans les deux ans à venir. Organisée en deux pôles [recherche à Palaiseau et technique à Bruz], elle sera dirigée par Bertrand Rondepierre, un ancien de l’École Polytechnique, passé par Google.

Le Général de Gaulle a lancé le Commissariat à l’énergie atomique en 1945 et le premier sous-marin lanceur d’engins, qui porte la dissuasion nucléaire française, a été lancé en 1972 sous Giscard d’Estaing [sic, c’était sous la présidence de Georges Pompidou, ndlr]. Avec l’AMIAD, j’espère lancer le même processus : doter la France des moyens pour subvenir à ses besoins de façon souveraine sur le long terme. Cette agence est un point de départ, pas d’arrivée

, a conclu M. Lecornu.

lire la suite sur le site d'origine...

Source :

Opex360

Publié le par Laurent LAGNEAU

En parler sur le forum

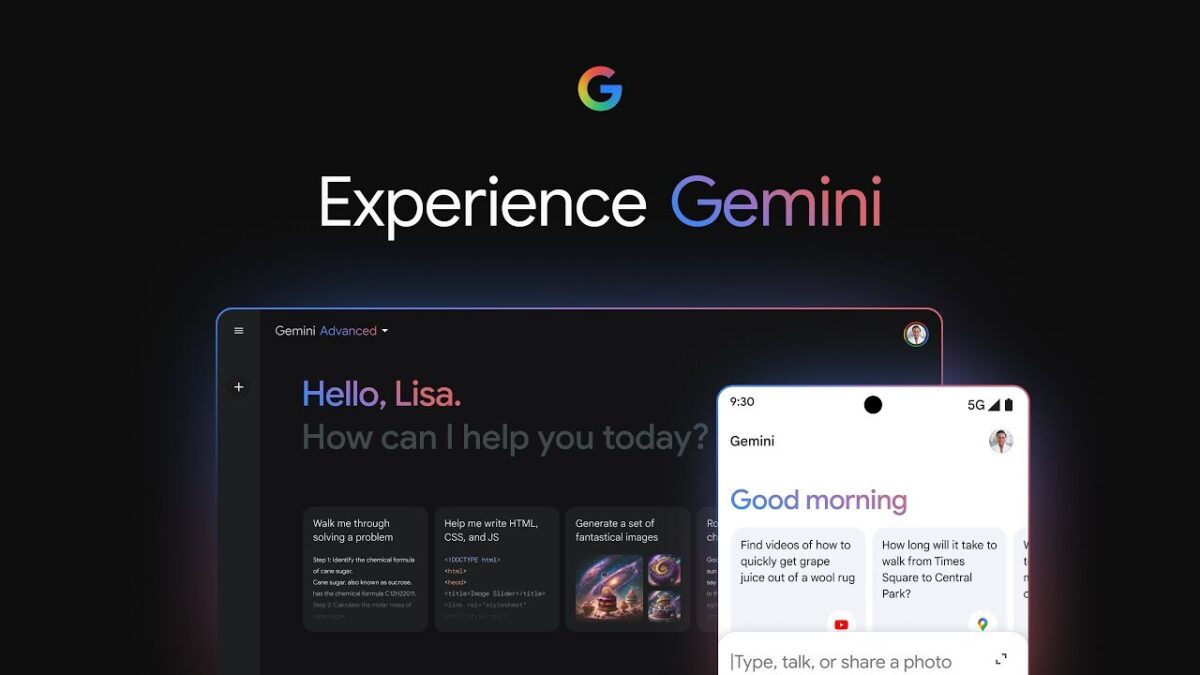

L'Avènement de l'Ère Gemini : Google Repousse les Limites de l'IA

Google intensifie son engagement dans l'intelligence artificielle, ouvrant une nouvelle ère de progrès technologiques avec l'ère Gemini. En établissant un "nouvel état de l'art à travers un large éventail de benchmarks de texte, d'image, d'audio et de vidéo", grâce à son modèle Ultra 1.0 qui surpasse "les experts humains en compréhension du langage multitâche (MMLU)", Google redéfinit les frontières de l'IA. L'objectif dépasse la simple amélioration des modèles d'IA pour englober un écosystème complet, enrichissant aussi bien les produits destinés au grand public que les outils pour les développeurs.

Crédit image : Google

Crédit image : Google

Gemini Advanced transforme l'expérience utilisateur en proposant des capacités avancées en "raisonnement, d'exécution d'instructions, de codage et de collaboration créative". Disponible en 40 langues et bientôt à travers des applications dédiées, cette innovation est accessible via le nouveau plan Google One AI Premium, qui concentre le meilleur de l'IA de Google en un seul lieu.

L'expansion de Gemini à Workspace et Google Cloud promet d'augmenter la productivité et de stimuler l'innovation. Google rapporte déjà une adoption significative, avec "plus d'un million de personnes utilisant des fonctionnalités comme 'Aidez-moi à écrire'" pour booster leur créativité et efficacité.

En mettant l'accent sur le rôle des développeurs dans l'expansion de l'écosystème Gemini, Google anticipe de futures révélations qui "se concentreront sur les nouvelles capacités pour les développeurs et les clients Cloud". L'entreprise affirme son engagement envers une innovation audacieuse et responsable, annonçant des avancées continues dans l'IA.

Cette stratégie illustre comment Google envisage l'avenir de l'IA, en combinant technologie de pointe et accessibilité pour remodeler l'interaction numérique et améliorer la productivité à une échelle globale.

L'ère Gemini marque un tournant majeur dans l'évolution de l'intelligence artificielle chez Google, signalant non seulement des avancées technologiques remarquables mais aussi une vision stratégique étendue à un écosystème complet. Avec Gemini Advanced et l'intégration de ces technologies dans des produits largement utilisés comme Workspace et Google Cloud, Google démontre son engagement à rendre l'IA plus accessible et utile pour tous. L'accent mis sur le développement et l'innovation ouvre de nouvelles avenues pour les créateurs, les entreprises et les utilisateurs finaux, promettant de transformer la façon dont nous interagissons avec la technologie au quotidien. La route vers l'avenir de l'IA chez Google est pavée d'innovations responsables et d'une ambition de rendre chaque expérience plus intuitive, productive et créative, soulignant l'importance de l'intelligence artificielle dans le façonnement de notre monde numérique.

Sources multiples :

Google

BDM

Publié le par Technifree

En parler sur le forum

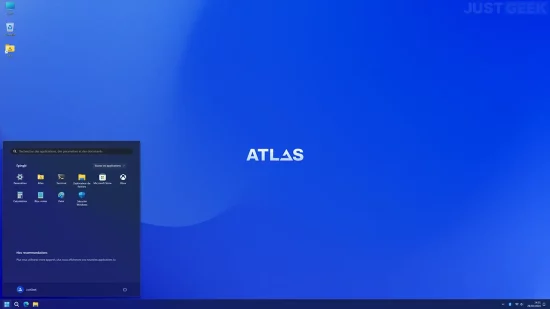

AtlasOS : une version allégée de Windows 11 et 10

On ne change pas d’ordinateur comme de chemise. Pour des raisons économiques évidentes, mais également par considération écologique. Alors que faire lorsque nous avons un PC Windows un peu à la traine ? Surtout, ne le jetez pas, car AtlasOS, une version allégée et optimisée de Windows 11 et 10, pourrait bien être la solution que vous cherchez. Cet outil est conçu pour booster les performances de votre système, le rendant plus rapide et plus réactif sans nécessiter d’investissement dans du nouveau matériel.

Dans cet article, nous vous présentons en détail AtlasOS, à qui il est destiné et comment facilement l’installer sur votre PC. Suivez le guide !

Crédit image : france24 - AFP

Crédit image : france24 - AFP

AtlasOS est un outil open source qui permet d’améliorer les performances globales de Windows 11 ou Windows 10 en éliminant tous les composants superflus. Il ne faut donc pas le voir comme un nouveau système d’exploitation à part entière, mais plutôt comme un utilitaire d’optimisation. Autrement dit, contrairement à une image ISO modifiée de Windows, comme Tiny11, AtlasOS est un logiciel qui s’installe pour offrir une expérience utilisateur Windows plus fluide et réactive, en se débarrassant de tout ce qui pourrait ralentir votre PC.

Cependant, rassurez-vous, l’installation d’AtlasOS ne modifie en rien l’utilisation habituelle de votre PC. Vous pourrez continuer à installer et utiliser vos applications préférées, jouer à vos jeux favoris, et naviguer sur Internet sans aucune restriction. En somme, AtlasOS optimise discrètement les performances de votre système sans impacter votre expérience utilisateur quotidienne.

Pour optimiser votre système, AtlasOS procède à des ajustements spécifiques :

• Désactive de nombreux aspects de l’interface qui consomment de précieuses ressources système, allégeant ainsi la charge sur votre processeur et votre mémoire vive.

• Désactive les fonctionnalités d’économie d’énergie, optimisant les performances au détriment de la consommation énergétique, pour ceux qui privilégient la réactivité à l’autonomie.

• Désactive les publicités intégrées par défaut dans l’expérience utilisateur de Windows, offrant ainsi une interface plus propre.

• Supprime les applications préinstallées et les bloatwares, libérant de l’espace disque et des ressources système pour des applications que vous choisissez et utilisez vraiment.

• Supprime la majorité de la télémétrie intégrée à Windows, réduisant ainsi l’empreinte de la collecte de données par Microsoft.

• Implémente de nombreuses stratégies de groupe pour minimiser la collecte de données, assurant une expérience utilisateur plus sécurisée et privée.

Et bien plus encore… Mais malgré ces nombreuses modifications, AtlasOS conserve l’intégrité des fonctionnalités liées à la sécurité de votre ordinateur. Vous bénéficiez ainsi du meilleur des deux mondes : une expérience Windows optimisée et personnalisable, sans aucun compromis sur la sécurité et la familiarité de votre système.

lire la suite sur le site d'origine...

Publié le par Benjamin sur JustGeek.fr

En parler sur le forum