Le jeu du chat et de la souris entre l'homme et la machine ou comment comprendre l'univers fascinant des CAPTCHAs

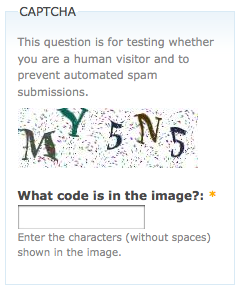

Ah, les CAPTCHAs ! Qui aurait cru que cette petite boîte agaçante que nous cochons presque machinalement (je ne sais pas si ça se dit, mais bon, j'aime bien les cochons .... que voulez vous !) sur les sites web avait tant à dire sur nous, simples mortels, face à la montée implacable des machines ? Si vous avez déjà passé plus de cinq minutes sur Internet, vous avez sans doute été accueilli par cette fameuse case à cocher : « Je ne suis pas un robot ». Mais pourquoi, au juste, un robot ne peut-il pas simplement prétendre ne pas être ce qu'il est ?

Crédit image : geeksforgeeks.org

Crédit image : geeksforgeeks.org

Un peu d'histoire pour briller en société

Avant de plonger dans le vif du sujet, remontons un peu le temps. Le terme CAPTCHA, qui semble sorti tout droit d'un film de science-fiction, est en réalité un acronyme pour "Completely Automated Public Turing test to tell Computers and Humans Apart" (Test de Turing complètement automatisé pour distinguer les ordinateurs des humains). Ces tests ont été conçus pour empêcher des programmes informatiques, appelés bots, de remplir des formulaires en ligne à notre place. Imaginons un monde où acheter des billets pour votre concert favori devient impossible parce Terminator les a tous achetés en quelques secondes. Frustrant, non ?

Comment fonctionnent les CAPTCHAs ?

Le principe est simple : donner à l'utilisateur une tâche que les machines trouvent difficile à réaliser. Initialement, cela impliquait de lire du texte sur des images déformées. Humains : 1, Robocop : 0. Mais les robots ont vite appris à lire ces textes déformés, poussant les développeurs à élaborer des CAPTCHAs toujours plus sophistiqués.

La version 2 du reCAPTCHA de Google ne se contente pas de voir si vous pouvez identifier des images de feux de circulation ou de chats (on est tous d'accord, on aime les chats hein !), mais elle observe comment vous interagissez avec ces demandes. Les humains ont une manière naturellement imparfaite et incohérente de bouger leur souris ou de cliquer, une signature que les robots ont du mal à imiter.

Pourquoi les robots sont-ils à la traîne ?

Vous pourriez penser qu'avec tous les progrès en I.A., simuler un comportement humain pourrait être un jeu d'enfant pour Alicia, la robotte (bon là, c'est une référence à ex-Machina, faut suivre !). Mais là réside le vrai défi : imiter l'aléatoire naturel des actions humaines est extrêmement complexe. Cela requiert une nuance de comportement que les algorithmes ont encore du mal à maîtriser. Pensez-y comme essayer de programmer un robot pour qu'il agisse comme tonton Marcel au repas de famille — imprévisible et avec un goût douteux pour les blagues de boomer !

Et après ? Que nous réserve le futur des CAPTCHAs ?

L'évolution ne s'arrête jamais. Avec reCAPTCHA v3, Google a commencé à analyser le comportement des utilisateurs en arrière-plan, promettant une expérience moins intrusive (et peut être plus curieuse). Imaginez un monde où vous n'avez plus besoin de prouver que vous n'êtes pas un robot, parce que Google le sait déjà grâce à votre manière unique de naviguer sur le web (et les données qu'il possède sur vous ... mais ça, c'est un autre article).

Une touche d'humanité dans ce monde de brute numérique

Cliquer sur "Je ne suis pas un robot" peut sembler un geste banal, mais c'est un rappel poignant que dans cet univers, notre humanité est ce qui nous rend uniques. Et pendant que nous continuons à naviguer, à cliquer, et à interagir, les robots continueront de tenter de nous rattraper — toujours à un clic de distance.

En somme, la prochaine fois que vous rencontrerez un CAPTCHA dans la rue, prenez un moment pour apprécier cette petite compétition entre vous et la machine. Qui sait ? Peut-être que votre participation à ce jeu de cache-cache numérique est ce qui aide à garder Internet un peu plus sécurisé et, ironiquement, plus humain.

Article rédigé en partie avec l'aide de Chat GPT 4.

Sources multiples :

Ballajack

geeksforgeeks

Google

Cet article a été écrit avec un combo IA + bon sens humain.

Parce que l’un sans l’autre, c’est souvent foireux !

Publié le par Technifree

En parler sur le forum

Les États-Unis interdisent l'antivirus russe Kaspersky sous prétexte de souveraineté numérique

Le gouvernement américain vient d'annoncer l'interdiction du logiciel antivirus russe Kaspersky sur son territoire, invoquant des raisons de sécurité nationale et de protection des données des citoyens. Cette décision s'inscrit dans un contexte de tensions géopolitiques croissantes entre les États-Unis et la Russie, et soulève d'importantes questions sur la cybersécurité et la souveraineté numérique.

Crédit image : Kaspersky

Crédit image : Kaspersky

Une méfiance de longue date

Selon Nicolas Arpagian, spécialiste en risques numériques à franceinfo, cette interdiction n'est pas une surprise. Elle s'inscrit dans la continuité d'une méfiance exprimée depuis 2017 par l'administration américaine envers Kaspersky. Les autorités américaines soupçonnent que le Kremlin pourrait contraindre l'entreprise russe à exploiter ses capacités techniques pour collecter des informations sensibles sur les systèmes informatiques américains.

La cybersécurité, un enjeu stratégique

L'expert souligne que dans le domaine de la cybersécurité, il est difficile de prouver l'existence de comportements malveillants. La suspicion est donc omniprésente, surtout dans un contexte de concurrence politique, économique et militaire entre grandes puissances. Les États-Unis craignent que la Russie puisse exploiter les données collectées par Kaspersky à des fins stratégiques.

Quelle attitude adopter ?

Face à cette situation, Nicolas Arpagian rappelle que chaque utilisateur reste libre de ses choix en matière de logiciels. Cependant, il est important d'être conscient des enjeux et des risques potentiels. En France, les administrations ont déjà pris des mesures pour diversifier leurs prestataires de cybersécurité.

Vers une souveraineté numérique ?

L'expert plaide pour un recours accru aux technologies nationales ou européennes dans le domaine de la cybersécurité. Cette approche permettrait de renforcer l'autonomie stratégique et la souveraineté numérique des pays européens. Il encourage les consommateurs à prendre conscience de l'impact de leurs choix sur l'écosystème numérique national et européen.

L'interdiction de Kaspersky aux États-Unis met en lumière les enjeux complexes de la cybersécurité à l'ère de la mondialisation numérique. Elle souligne l'importance croissante de la souveraineté technologique dans un monde où les tensions géopolitiques se cristallisent de plus en plus autour des questions numériques.

Article rédigé en partie avec l'aide de l'IA Claude.

Source :

franceinfo:

Cet article a été écrit avec un combo IA + bon sens humain.

Parce que l’un sans l’autre, c’est souvent foireux !

Publié le par Technifree

En parler sur le forum

La France connectée ou la progression fulgurante de la fibre optique en 2024

À l'heure où la technologie devient chaque jour un peu plus le coeur battant de nos vies, l'ARCEP (Autorité de régulation des communications électroniques) vient de livrer son bilan pour le premier trimestre de l'année 2024, et les chiffres sont aussi encourageants qu'impressionnants.

Crédit image : DALL-E

Crédit image : DALL-E

Au cours de ce trimestre, la fibre optique a connu une ascension fulgurante avec 810 000 nouveaux abonnements, surpassant même le nombre de nouveaux raccordements (680 000 locaux rendus raccordables). À ce rythme, la France file tout droit vers une couverture totale, avec déjà 87 % des locaux raccordables à cette technologie qui révolutionne notre manière de vivre et de travailler.

Mais qu'en est-il des régions moins denses et des territoires jusqu'alors moins privilégiés ? L'ARCEP confirme des progrès notables : 460 000 locaux ont été équipés dans les zones d'initiative publique et 140 000 dans les zones d'initiative privée moins denses. Ces efforts démontrent une volonté ferme d'équilibrer l'accès au très haut débit sur tout le territoire.

Malgré un léger ralentissement comparé à l'année précédente, le nombre total d'abonnements internet à haut et très haut débit s'élève désormais à 32,3 millions, avec la fibre optique représentant près de 70 % de ce total. Ce sont des nouvelles qui promettent de transformer notre quotidien, notamment en améliorant l'accès aux services numériques, l'éducation en ligne, et bien plus encore.

L'ARCEP ne se repose pas pour autant sur ses lauriers. L'autorité a récemment mis en demeure certains opérateurs pour accélérer le déploiement et respecter les engagements pris. L'objectif ? Une France totalement connectée d'ici fin 2025.

Pour suivre les avancées ou vérifier si votre domicile peut être raccordé, rendez-vous sur le site de l'ARCEP ou sur "Ma connexion internet", où des cartes détaillées vous attendent. C'est une ère de connectivité sans précédent qui se profile, et chaque Français est invité à en faire partie.

C'est bien beau tout ça, mais qu'est-il prévu pour rassurer papy et mamie qui n'en ont aucunement besoin ?

Alors que la France se dirige vers une couverture intégrale en fibre optique, une question demeure pour nos aînés : comment gérer les nouveaux équipements qui accompagnent cette technologie ? La réponse réside dans l'accompagnement et les services d'assistance dédiés.

Les fournisseurs de services internet, conscients de ces défis, mettent en place des programmes d'assistance pour aider à l'installation et à la configuration des nouveaux équipements, comme les boîtiers de fibre optique nécessaires pour la télévision et le téléphone. Ces services peuvent inclure des visites à domicile où des techniciens expliquent de manière simple et claire comment utiliser les nouveaux dispositifs.

En outre, de nombreuses associations proposent des formations spécifiques pour les seniors, leur permettant d'apprendre à utiliser ces technologies à leur propre rythme. Ces sessions visent à démythifier la technologie et à rendre les aînés plus autonomes dans leur utilisation quotidienne d'internet et des communications.

Il est également important de noter que les opérateurs offrent souvent des interfaces simplifiées pour ceux qui le souhaitent, réduisant la complexité des télécommandes ou des menus à l'écran. Ainsi, regarder la télévision ou passer un appel reste une expérience familière et non intimidante.

Les fournisseurs de services et les organismes gouvernementaux travaillent ensemble pour que la technologie améliore la vie de tous les Français, sans exception. Les normes et régulations en place visent à s'assurer que chaque individu, quelles que soient ses capacités ou ses besoins, puisse bénéficier de la révolution numérique en toute sécurité et avec le maximum de facilité.

L'objectif est clair : garantir que le passage à la fibre optique ne laisse personne derrière, surtout pas nos aînés, pour qui le changement peut sembler une montagne insurmontable. L'effort national en matière de numérisation est ainsi couplé à un engagement tout aussi sérieux envers l'accessibilité et l'inclusion.

Sources multiples :

Arcep

Cet article a été écrit avec un combo IA + bon sens humain.

Parce que l’un sans l’autre, c’est souvent foireux !

Publié le par Technifree

En parler sur le forum

Quand les sites web disparaissent dans les méandres du web

Savez-vous que 38 % des pages internet qui existaient en 2013 sont désormais inaccessibles ? Cela représente plus de 250 millions de sites qui ont disparu dans les méandres du web ! Ce phénomène, appelé "dégradation numérique", touche tous les types de sites, des sites gouvernementaux aux réseaux sociaux, en passant par les sites de particuliers. Dans cet article, nous allons explorer les raisons de cette disparition massive de sites web et les conséquences que cela peut avoir pour les individus, les entreprises et les gouvernements. Prêt à plonger dans les profondeurs du web ?

Crédit image : DALL-E

Crédit image : DALL-E

Salut tout le monde ! Aujourd'hui, je vais vous parler d'un phénomène qui touche le monde numérique et qui est loin d'être drôle : la "dégradation numérique". Selon une étude réalisée par le Pew Research Center, 38 % des pages internet qui existaient en 2013 sont désormais inaccessibles. Oui, vous avez bien lu, plus de 250 millions de sites ont disparu dans les méandres du web !

Mais avant de rentrer dans le vif du sujet, laissez-moi vous donner quelques chiffres pour vous faire comprendre l'ampleur du phénomène. Selon les données du Real Time Statistics Project, le nombre de sites Internet en ligne a été multiplié par dix entre 2008 et 2017, passant de 172 millions à plus d’1,7 milliard. Et oui, en à peine 10 ans, le nombre de sites a explosé !

Mais alors, comment expliquer la disparition de tous ces sites ? Les raisons sont multiples et variées. Tout d'abord, les sites gouvernementaux sont concernés par ce phénomène. En effet, la plupart d'entre eux ont migré vers des adresses sécurisées "https", ont été transformés en documents "statiques" (comme des PDF) ou redirigent désormais vers une nouvelle adresse. Et oui, même les gouvernements ne sont pas à l'abri de la "dégradation numérique" !

Mais ce phénomène ne touche pas que les sites gouvernementaux, les particuliers sont également concernés. En effet, la maintenance d'un site génère des frais qui sont généralement compensés par le trafic. Mais lorsqu'une page cesse d'être visitée, elle perd la raison de son existence et finit par disparaître. Et oui, sur le web, il faut savoir se renouveler pour ne pas sombrer dans l'oubli ! (et là, je sais de quoi je parle !)

Mais le phénomène de la "dégradation numérique" ne s'arrête pas là. Selon une étude du Pew Research Center, 21 % des pages officielles comportent au moins un lien inaccessible. Et oui, même les pages officielles ne sont pas à l'abri des liens morts !

Mais ce n'est pas tout, les réseaux sociaux sont également concernés par ce phénomène. En effet, près d'un cinquième (18 %) des tweets publiés dans le cadre de l’étude du Pew ont disparu en à peine quelques mois. Et oui, même sur les réseaux sociaux, il faut savoir être réactif pour ne pas disparaître !

Enfin, dernier exemple et non des moindres, Wikipedia. Selon une étude, plus de la moitié (54 %) des références renvoient vers des pages qui n’existent désormais plus. Et oui, même la célèbre encyclopédie en ligne n'est pas à l'abri de la "dégradation numérique" !

Alors, que faire pour lutter contre ce phénomène ? Tout d'abord, il est important de bien référencer ses pages et de vérifier régulièrement les liens pour éviter les liens morts. Ensuite, il est important de mettre à jour régulièrement son site pour maintenir l'intérêt des visiteurs. Enfin, il est important de sauvegarder régulièrement son site pour éviter de tout perdre en cas de problème.

Voilà, vous savez tout sur la "dégradation numérique". Alors, n'oubliez pas de bien entretenir votre site et de sauvegarder régulièrement vos données pour éviter de disparaître dans les méandres du web !

Sources multiples :

Pew Research

Real Time Statistics Project

Le Grand Continent

Cet article a été écrit avec un combo IA + bon sens humain.

Parce que l’un sans l’autre, c’est souvent foireux !

Publié le par Technifree

En parler sur le forum

Perdu ? Pas tant que ça ! Découvrez le nouveau réseau "Localiser mon appareil", votre futur espion préféré (ou pas)

Bon, qui n'a jamais perdu ses clés ou oublié où il avait garé sa voiture dans un parking immense ? Bien sûr, tout le monde ! Mais bonne nouvelle, chers distraits et têtes en l'air : le nouveau réseau "Localiser mon appareil" arrive pour surveiller vos affaires mieux que jamais. Et oui, même hors ligne. On parle de vraie magie moderne, ou juste d'une nouvelle façon de se faire espionner ? À vous de voir !

Crédit image : Vecteezy

Crédit image : Vecteezy

Imaginez un monde où même sans internet, vos gadgets pourraient vous dire où ils se cachent. Grâce au Bluetooth et à un milliard de dispositifs Android anonymes traînant partout, ce nouveau joujou va localiser votre téléphone perdu, votre sac, ou même vos écouteurs qui ont encore disparu sous le canapé. Pratique, non ?

Alors, oui, on nous promet que tout est super sécurisé. Les positions sont chiffrées avec des codes secrets que même Google ne peut pas lire. C’est un peu comme le Club des cinq, mais pour retrouver vos affaires perdues. Vous seul et vos complices de confiance pouvez savoir où se trouvent vos précieuses affaires. Rassurant, pas vrai ?

Au-delà de retrouver votre smartphone dans la jungle urbaine, ce réseau va transformer chaque appareil Android en petit détective privé. Perdu quelque chose ? Pas de panique, votre communauté est là pour vous aider à retrouver vos biens égarés. C’est presque émouvant, cette entraide technologique, c'est bô.

Si vous êtes comme moi, du genre parano ou simplement prudent, vous pouvez toujours choisir de ne pas participer à ce grand réseau de la retrouvaille. Désactivez simplement l'option dans les paramètres, et voilà, vous êtes hors de la matrice (sauf si vous avez pris la pilule rouge, bien sûr)

Avant de vous précipiter pour aller voir ce que ça donne (car cette fonction s'active par défaut), peut-être voudrez-vous réfléchir à tout ce que cela implique. Oui, c’est génial de ne jamais perdre vos affaires, mais êtes-vous prêt à laisser un milliard de dispositifs savoir où vous êtes ? Ça mérite une petite réflexion, non ?

Qu'en pensez-vous ? Pratique ? Flippant, mais sûrement révolutionnaire ? À l'ère du numérique, perdre ses affaires pourrait bien devenir un lointain souvenir, tout comme votre vie privée. Ironie du sort, non ?

Source :

Google

Cet article a été écrit avec un combo IA + bon sens humain.

Parce que l’un sans l’autre, c’est souvent foireux !

Publié le par Technifree

En parler sur le forum

Les nouveautés de Firefox en 2024, toujours plus de liberté et de personnalisation

Chez Mozilla, on ne plaisante pas quand on parle de mise à jour et de nouveautés. Leur mission ? Faire de Firefox le navigateur de choix pour tous, un espace où la liberté de navigation règne sans compromis. Accrochez-vous : des mises à jour importantes et des améliorations conséquentes vous attendent cette année !

Crédit image : Mozilla

Crédit image : Mozilla

Des fonctionnalités très attendues vont faire leur apparition

Mozilla a écouté ses utilisateurs et a mis le paquet sur les fonctionnalités que vous attendiez (enfin, je l'espère). Préparez-vous à booster votre productivité avec des options telles que le regroupement d'onglets, les onglets verticaux et une barre latérale des plus pratiques pour garder un œil sur vos 7 ou 7500 onglets ouverts. Sans parler du nouveau système de gestion de profils, qui permet de séparer clairement navigation personnelle, scolaire et professionnelle, mais sans les perdre de vue.

Vous voulez personnaliser votre navigateur ? Les nouveaux fonds d'écran pour les onglets neufs sont là pour ça ! Choisissez parmi une gamme variée de photographies, couleurs, et images abstraites celle qui vous ressemble le plus. Et pour ceux qui tiennent à leur vie privée (si... si... y'en a encore !), les nouveaux paramètres de confidentialité intuitifs exploitent les technologies anti-pistage de Mozilla tout en restant simples à comprendre. De plus, les menus épurés réduisent le fouillis visuel et mettent en avant les actions les plus utilisées pour que vous puissiez accéder plus rapidement à l'essentiel.

Plus rapide, plus fort : l’engagement continu de Mozilla

La vitesse est de mise dans le monde en ligne, donc Mozilla redouble d'efforts pour rendre Firefox aussi rapide et efficace que possible. Attendez-vous à un navigateur plus véloce, avec des chargements de pages et des démarrages plus rapides, tout en économisant la batterie de votre téléphone ou votre PC portable, lorsqu'il est installé sur ce type de matériel. Ils ont même boosté la réactivité de 20 %, grâce à Speedometer 3, un projet mené avec d'autres géants technologiques. Et parce que l'esprit de collaboration est fort chez eux, ils participent aussi au projet Interop pour faciliter la création de sites optimisés pour tous les navigateurs.

Vie privée et utilité sans compromis

La vie privée, c’est sacré chez Firefox. Contrairement à d'autres (non, on ne citera aucun nom... j'ai pas dit Google, ni Safari, Ni Edge, non, je l'ai pas dit :-P), Mozilla ne vous demande pas de troquer vos données contre une expérience en ligne de base. Lire une nouvelle dans une autre langue ou remplir un formulaire ne devrait pas vous coûter votre vie privée. Ainsi, ils ont veillé à ce que des fonctions comme la traduction et l'édition de PDF se fassent localement, sur votre appareil. Pas de transfert de vos données vers des fermes de serveurs externes ; chez Firefox, vos données restent les vôtres, point barre !

Et l'IA dans tout ça ?

Ah, l'intelligence artificielle... un sujet à la fois brûlant et passionnant !

Mozilla s'y prend avec la même philosophie : des fonctionnalités IA qui résolvent des problèmes concrets, respectent votre vie privée et vous laissent le choix. Prochainement, ils déploieront des modèles d'IA locaux pour générer du texte alternatif pour les images dans les PDF, améliorant l'accessibilité pour les utilisateurs malvoyants ou ayant des difficultés d'apprentissage. Tout ceci, traité sur votre appareil, pour garantir que même les améliorations technologiques respectent votre sphère privée.

Alors, prêts à naviguer avec encore plus de puissance et de respect de la confidentialité ? Firefox vous attend, plus performant que jamais. Restez connectés, car ils n'ont pas encore fini de vous surprendre !

Pour voir ce que ça donne à l'heure actuelle, vous pouvez télécharger la version Nightly (la béta quoi) sous linux (version apt ici) ou Windows.

Sources multiples :

Korben

Mozilla

Publié le par Technifree

En parler sur le forum

Décès de Robert Dennard, inventeur de la DRAM et pionnier de l'informatique moderne à l'âge de 91 ans.

Robert Dennard, l'inventeur de la technologie de mémoire vive dynamique (DRAM) qui a révolutionné l'informatique moderne, est décédé à l'âge de 91 ans. Cette technologie, brevetée en 1968, est utilisée aujourd'hui dans presque tous les ordinateurs, serveurs et appareils électroniques grand public sur le marché.

Crédit image : IBM

Crédit image : IBM

Né en 1932 dans une ferme sans électricité au Texas, Dennard a étudié l'ingénierie électrique à l'Université méthodiste du Sud grâce à une bourse d'études en tant que joueur de cor français. Il a ensuite poursuivi ses études à l'Institut de technologie Carnegie, maintenant connu sous le nom de Carnegie Mellon, où il a obtenu son doctorat en 1958.

Dennard a commencé à travailler chez IBM en tant que chercheur et y est resté pour le reste de sa longue et prestigieuse carrière. Au début des années 1960, il a développé la DRAM, une alternative plus rapide et de plus grande capacité à la mémoire à noyau magnétique existante.

En plus de la DRAM, Dennard a également développé la théorie de l'échelle de Dennard en 1972, qui a aidé les ordinateurs et autres appareils électroniques à devenir plus petits, plus rapides et plus efficaces chaque année. Cette théorie, également connue sous le nom de loi de Dennard, découle de la loi de Moore, qui stipule que le nombre de transistors pouvant tenir dans un espace donné double environ tous les deux ans.

Au cours de sa carrière, Dennard a reçu de nombreux prix et distinctions. Il a été nommé IBM Fellow en 1979 et a reçu la Médaille nationale américaine de la technologie des mains du président Ronald Reagan en 1988. En 1997, Dennard a été intronisé au Temple de la renommée des inventeurs nationaux des États-Unis et a reçu la Médaille d'honneur de l'IEEE en 2009.

Dennard laisse dans le deuil sa femme, Jane Bridges, et ses filles Amy et Holly Dennard, ainsi que quatre petits-enfants. Son fils, Robert H. Dennard, Jr., est décédé avant lui. Un service commémoratif en l'honneur de Dennard est prévu pour le 7 juin à 13 heures, heure de l'Est, à Yorktown Heights, New York.

Sources multiples :

Le Figaro

Tom's Hardware

Publié le par Technifree

En parler sur le forum

Le chiffrement et le cryptage, c'est comme le ketchup et la sauce tomate, c'est presque pareil mais pas tout à fait !

On va parler de quelque chose qui peut sembler un peu compliqué, mais je vais faire de mon mieux pour le rendre aussi simple que possible. Vous avez peut-être déjà entendu les termes "chiffrement" et "cryptage" et vous vous demandez quelle est la différence entre les deux. Eh bien, vous êtes au bon endroit, parce qu'on va justement essayer de clarifier tout ça !

Crédit image : Mauro Sbicego

Crédit image : Mauro Sbicego

Tout d'abord, il est important de noter que les termes "chiffrement" et "cryptage" sont souvent utilisés de manière interchangeable, mais en réalité, ils ne veulent pas dire exactement la même chose (d'où mon exemple de Ketchup de sauce tomate). En fait, le terme anglais "encryption" se traduit en français par "chiffrement", ce qui peut ajouter à la confusion.

Alors quelle est la différence entre les deux ? Eh bien, la cryptographie est une discipline beaucoup plus ancienne que le chiffrement. Elle remonte à l'époque des Babyloniens (non, pas les potes de Bob Marley), qui utilisaient des techniques de substitution de lettres ou de chiffres pour protéger leurs messages. La cryptographie est l'art de protéger des messages en utilisant des secrets ou des jeux de mots.

Le chiffrement, quant à lui, est une sous-discipline de la cryptographie qui fait appel à une clé pour rendre la lecture d'un message impossible à toute personne qui ne possède pas cette clé. Sans la clé de déchiffrement, un message écrit en clair devient incompréhensible (eh oui, un mot de passe est une clé).

Certains experts datent les débuts du chiffrement à la fameuse machine Enigma utilisée pendant la Seconde Guerre mondiale. Cette machine permettait aux Allemands de chiffrer et déchiffrer leurs communications de manière dynamique. Le mathématicien britannique Alan Turing a réussi à "casser" le code de la machine Enigma en créant une autre machine, ce qui a en quelque sorte servi de clé.

En 1973, l'algorithme de chiffrement DES (Data Encryption Standard) est devenu un standard pour les entreprises. Dans les années 70, l'algorithme de cryptographie asymétrique RSA a également popularisé le modèle de paire de clés. Une clé publique permet de chiffrer les données, tandis qu'une clé privée permet de les déchiffrer. La clé publique peut être partagée avec n'importe qui (de confiance, si possibe), tandis que la clé privée est connue du seul destinataire.

Il est important de noter que pour "casser" une clé, la principale méthode des hackers consiste à utiliser la "force brute", c'est-à-dire à passer en revue toutes les combinaisons possibles. C'est pourquoi il est important d'utiliser des clés suffisamment longues et complexes pour rendre cette tâche aussi difficile que possible.

L’Académie française reconnaît le terme de crypter, mais dans le cadre de la télévision à péage pour parler des chaînes « cryptées ».

"on chiffre les messages et on crypte les chaînes", annonce-t-elle.

Maintenant, vous vous demandez peut-être pourquoi tout cela est important. Eh bien, dans un monde de plus en plus connecté, la protection de nos informations personnelles et sensibles est devenue une préoccupation majeure. Le chiffrement est l'un des moyens les plus efficaces de protéger ces informations contre les pirates informatiques et autres personnes malveillantes.

En résumé, la cryptographie et le chiffrement sont deux disciplines distinctes qui poursuivent le même but : protéger des informations sensibles. Alors que la cryptographie utilise des secrets ou des jeux de mots pour protéger les messages, le chiffrement fait appel à une clé pour rendre la lecture d'un message impossible à toute personne qui ne possède pas cette clé.

J'espère que cela a aidé à clarifier les choses et que vous avez appris quelque chose de nouveau aujourd'hui. N'oubliez pas de protéger vos informations personnelles et de rester vigilant en ligne.

Et le premier qui me parle encore de crypter des données, me recopiera 100 fois cet article !

Sources multiples :

Wikipedia

PrimX

Publié le par Technifree

En parler sur le forum

ChatGPT 4o, le nouveau venu dans la famille des assistants IA

La famille des assistants IA de chez OpenAI s'agrandit avec l'arrivée de ChatGPT 4o ! Après le succès de ChatGPT 3.5, puis de ChatGPT 4, la question se pose de quelle version choisir ? Dans cet article, nous vous proposons un petit comparatif de ces trois solutions pour vous aider à y voir un peu plus clair.

Crédit image : freepik

Crédit image : freepik

ChatGPT 3.5 : l'assistant IA polyvalent

Sorti en février 2022, ChatGPT 3.5 est un assistant IA généraliste, capable de répondre à une grande variété de questions, de générer du texte, ou encore de traduire des phrases. Il se base sur un modèle de langage entraîné sur un large corpus de données, comprenant des livres, des articles de presse, ou encore des pages web indexées jusqu'en 2021.

Ses avantages :

- Gratuit et facile d'accès : il suffit de s'inscrire sur le site d'OpenAI pour pouvoir l'utiliser.

- Polyvalent : il peut être utilisé dans de nombreux domaines, de l'éducation à la rédaction de contenus.

- Fiable : il a été entraîné sur un grand nombre de données, ce qui lui permet de fournir des réponses précises et pertinentes.

Ses inconvénients :

- Moins performant que ChatGPT 4 sur certaines tâches, comme la génération de texte long ou la compréhension de questions complexes.

- Données basées jusqu'en 2021.

- Des limites d'utilisation : le nombre de requêtes par minute est limité, et le texte généré ne peut pas dépasser une certaine longueur.

ChatGPT 4 : l'assistant IA haut de gamme

Sorti en novembre 2022, ChatGPT 4 est une version améliorée de ChatGPT 3.5. Il se base sur un modèle de langage plus performant, capable de traiter des données plus complexes et de générer du texte de meilleure qualité. Il a été entraîné sur un corpus de données encore plus vaste que celui de ChatGPT 3.5, comprenant notamment des données scientifiques et techniques.

Ses avantages :

- Plus performant que ChatGPT 3.5 sur de nombreuses tâches, comme la génération de texte long ou la compréhension de questions complexes, il est également plus rapide dans la génération des réponses apportées.

- Capable de traiter des données plus complexes, ce qui le rend particulièrement adapté aux domaines scientifiques et techniques.

- Fiable et précis : il a été entraîné sur un grand nombre de données, ce qui lui permet de fournir des réponses de qualité.

Ses inconvénients :

- Payant : il faut souscrire à un abonnement pour pouvoir l'utiliser (env. 20€/mois)

- Des limites d'utilisation : le nombre de requêtes par minute est limité, et le texte généré ne peut pas dépasser une certaine longueur.

ChatGPT 4o : le petit dernier de la famille

Sorti en avril 2023, ChatGPT 4o est une version allégée de ChatGPT 4. Il se base sur le même modèle de langage que son grand frère, mais a été entraîné sur un corpus de données plus restreint, comprenant principalement des données généralistes.

Ses avantages :

- Gratuit et facile d'accès : il suffit de s'inscrire sur le site d'OpenAI pour pouvoir l'utiliser.

- Plus performant que ChatGPT 3.5 sur de nombreuses tâches, comme la génération de texte long ou la compréhension de questions complexes.

- Fiable et précis : il a été entraîné sur un grand nombre de données, ce qui lui permet de fournir des réponses de qualité.

Ses inconvénients :

- Moins performant que ChatGPT 4 sur certaines tâches, notamment celles qui nécessitent de traiter des données complexes ou scientifiques.

- Des limites d'utilisation : le nombre de requêtes par minute est limité, et le texte généré ne peut pas dépasser une certaine longueur.

Alors, quelle version choisir ?

Tout dépend de vos besoins et de votre budget. Si vous cherchez un assistant IA polyvalent et gratuit, ChatGPT 3.5 ou ChatGPT 4o sont de bons choix. En revanche, si vous avez besoin d'un assistant IA plus performant, capable de traiter des données complexes ou scientifiques, ChatGPT 4 est fait pour vous.

Dans tous les cas, gardez à l'esprit que ces assistants IA ont des limites, et qu'ils ne peuvent pas remplacer complètement l'intelligence et la créativité humaines.

Comprendre les différentes méthodes d'IA et leurs utilisations

Avant de choisir une solution d'IA, il est important de comprendre les différentes méthodes qui existent et leurs utilisations.

Les chatbots, comme ChatGPT, sont une forme d'IA qui utilise le traitement automatique du langage naturel (NLP) pour comprendre et répondre aux questions des utilisateurs.

Mais l'IA ne se résume pas aux chatbots ! Il existe d'autres solutions pour le grand public, comme les assistants vocaux (comme Siri ou Alexa), les systèmes de recommandation (comme ceux utilisés par Netflix ou Amazon), ou encore les voitures autonomes.

Le machine learning est également une méthode d'IA qui permet aux ordinateurs d'apprendre à partir de données, sans avoir été explicitement programmés pour cela. Il est souvent utilisé dans les chatbots et les assistants vocaux pour améliorer leur compréhension du langage naturel et leur capacité à répondre aux questions des utilisateurs.

Il y a aussi les API (Application Programming Interface) qui sont un ensemble de protocoles et de définitions de fonctions utilisées pour créer et interagir avec des applications logicielles. Dans le cas des solutions d'IA, une API peut être utilisée pour intégrer un chatbot ou un assistant vocal à un site web ou à une application mobile.

Les autres solutions du marché (eh oui, il n'y a pas qu'OpenAI)

Bien que les solutions d'OpenAI soient parmi les plus populaires et les plus performantes du marché, il existe d'autres solutions d'IA pour le grand public. Parmi celles-ci, on peut citer :

- Mistral AI : une entreprise française qui propose des solutions d'IA pour la compréhension et la génération de langage naturel.

- Claude.ai : une plateforme d'IA qui permet de créer des chatbots et des assistants vocaux personnalisés, sans avoir besoin de compétences en programmation.

- Gemini de Google : une solution d'IA qui permet de générer des réponses personnalisées à partir de données structurées, comme des tableaux ou des bases de données.

- Copilot de Microsoft : une solution d'IA qui permet d'assister les utilisateurs dans la rédaction de documents, en proposant des suggestions de phrases ou de paragraphes.

Ces solutions peuvent être des alternatives intéressantes à celles d'OpenAI, en fonction de vos besoins et de votre budget. N'hésitez pas à les comparer et à les tester pour trouver celle qui convient le mieux à votre projet.

Publié le par Technifree

En parler sur le forum

L'anonymat en ligne est un casse-tête chinois pour les internautes et les législateurs

Sur internet, l'anonymat est devenu un enjeu majeur pour les utilisateurs soucieux de protéger leur vie privée. Récemment, le député Renaissance Paul Midy a proposé une mesure pour le moins radicale : l'enregistrement obligatoire des utilisateurs de réseaux sociaux (lol). Une idée qui a fait bondir les défenseurs des libertés individuelles et qui soulève de nombreuses questions. Alors, l'anonymat en ligne est-il vraiment en danger ? Comment se protéger efficacement sur la toile ?

Crédit image : Julia M Cameron

Crédit image : Julia M Cameron

L'enregistrement obligatoire des utilisateurs de réseaux sociaux : une fausse bonne idée ?

Le député Paul Midy a récemment plaidé pour l'enregistrement obligatoire des utilisateurs des réseaux sociaux, afin de faciliter leur identification par la justice en cas de délit. Si l'intention peut sembler louable, cette proposition soulève de nombreuses inquiétudes quant à la protection de la vie privée et des libertés individuelles.

En effet, cette mesure, digne d'un roman d'Orwell, semble quelque peu utopique et liberticide. Comment s'assurer que les données personnelles collectées ne seront pas utilisées à mauvais escient ? Et quid de la possibilité de s'exprimer librement sur Internet, sans craindre d'éventuelles représailles ?

Cette proposition a d'ailleurs suscité de vives réactions, notamment de la part de la Quadrature du Net, qui a qualifié cette idée de "dangereuse et contre-productive".

Les VPN : amis ou ennemis de l'anonymat ?

Face à ces enjeux, de nombreux internautes se tournent vers les VPN (Virtual Private Network) pour préserver leur anonymat en ligne. Mais attention, tous les VPN ne se valent pas !

Certains VPN courants, comme CyberGhost, NordVPN ou ExpressVPN, investissent des sommes colossales dans leur publicité, mais offrent une protection de l'anonymat parfois discutable. En effet, certains d'entre eux conservent des logs (journaux de connexion) et peuvent donc être contraints de transmettre des informations aux autorités.

A contrario, des VPN moins connus, tels que Mullvad, PIA ou ProtonVPN, se démarquent par leur engagement en faveur de la protection de la vie privée. Associés à des navigateurs sécurisés comme Tor Browser, ces VPN offrent un anonymat quasi complet, sans laisser de trace.

L'anonymat en ligne est un enjeu crucial pour les générations Z et alpha

Si l'anonymat en ligne est un sujet important pour tous les internautes, il l'est d'autant plus pour les enfants et adolescents, souvent victimes de cyber-harcèlement via les réseaux sociaux (Facebook, Instagram, Snapchat) ou sur les jeux en ligne très populaires dans cette tranche d'âge (Fortnite, Minecraft, Roblox).

Il est donc essentiel de sensibiliser ces générations aux risques cyber et de leur apprendre à se protéger efficacement en ligne.

Quelques conseils simples peuvent déjà faire la différence :

• Utiliser des pseudonymes plutôt que son vrai nom

• Ne pas divulguer d'informations personnelles (adresse, date de naissance, numéro de téléphone, etc.)

• Paramétrer correctement ses comptes sur les réseaux sociaux (compte privé, liste d'amis restreinte, comptes non nominatifs, etc.)

• Signaler et bloquer les utilisateurs malveillants (aux modérateurs, administrateurs, etc.)

• Eviter les sites peu recommandables, bien des outils de protection ou de prévention existent pour ça ...

L'anonymat en ligne est un enjeu majeur pour les internautes, et il est essentiel de se protéger efficacement pour préserver sa vie privée et ses libertés individuelles. Si certaines mesures législatives peuvent sembler séduisantes, elles soulèvent de nombreuses questions et peuvent parfois s'avérer contre-productives.

Alors, plutôt que de compter sur Big Brother pour veiller sur nous, prenons nos responsabilités et adoptons les bons réflexes pour naviguer en toute sécurité sur Internet. Et n'oublions pas de transmettre ces précieux conseils aux générations futures pour qu'elles puissent elles aussi profiter pleinement d'un monde numérique averti (sans craindre pour leur anonymat).

Sources multiples :

Le Point

Le Point

Numerama

Publié le par Technifree

En parler sur le forum